L'intelligenza artificiale non è più una promessa futuristica, ma una realtà pervasiva che plasma le nostre interazioni, decisioni e persino il codice che scriviamo. Tuttavia, con la sua crescente autonomia e integrazione, sorgono interrogativi complessi: Chi è responsabile quando un algoritmo commette un errore? Come bilanciamo innovazione e tutela della privacy? Questi non sono dilemmi accademici, ma sfide urgenti che ogni azienda B2B deve affrontare proattivamente.

L'Espansione Inevitabile dell'AI e le Sue Ombre Etiche

L'adozione dell'AI, dai sistemi di raccomandazione ai veicoli autonomi, è esplosa. Strumenti come GitHub Copilot accelerano lo sviluppo, ma sollevano questioni sull'attribuzione del codice e sulla proprietà intellettuale. Sebbene il vantaggio in termini di produttività sia innegabile, l'attribuzione automatica nelle commit di codice, senza una chiara indicazione della provenienza o paternità umana, può generare complessità legali e ambiguità sulla responsabilità.

Non si tratta solo di codice. I bias negli algoritmi di assunzione possono perpetuare e amplificare disuguaglianze esistenti, escludendo candidati qualificati su basi discriminatorie. Sistemi di sorveglianza basati sull'AI, sebbene potenti per la sicurezza, sollevano gravi preoccupazioni sulla privacy e sul rischio di uso improprio dei dati personali. E cosa dire della responsabilità legale per un veicolo autonomo che provoca un incidente? La catena di colpa si estende dal produttore del sensore, all'ingegnere che ha scritto l'algoritmo di decisione, al proprietario del veicolo. Questi scenari non sono fantascienza; sono la quotidianità emergente che richiede risposte chiare e robuste.

La trasparenza ('explainability') diventa cruciale. Le aziende devono essere in grado di spiegare come i loro sistemi AI arrivano a determinate conclusioni, specialmente in contesti ad alto rischio come la finanza, la medicina o la selezione del personale. Senza questa capacità, la fiducia crolla e le controversie legali diventano inevitabili.

Il Quadro Normativo: L'AI Act e Oltre

Di fronte a queste sfide, i legislatori si stanno muovendo. L'Unione Europea, in particolare, è all'avanguardia con l'AI Act, una normativa ambiziosa che mira a regolamentare l'AI in base al livello di rischio. Per le PMI e le startup italiane, questo non è un dettaglio: significa che l'implementazione di sistemi AI ad alto rischio (come quelli usati per la selezione del personale, la valutazione del credito o la gestione delle infrastrutture critiche) richiederà rigorosi controlli di conformità, valutazioni d'impatto e un'attenta supervisione umana.

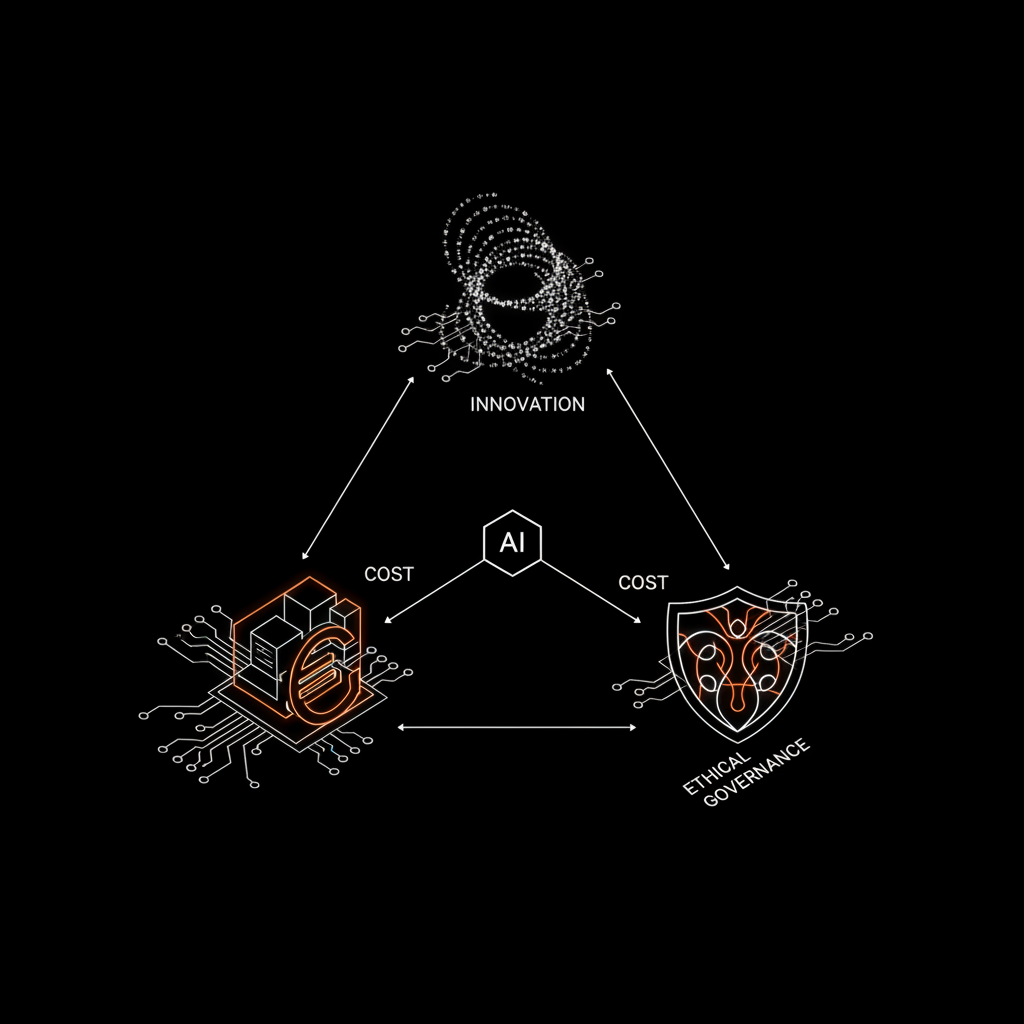

Il mancato rispetto di queste normative può comportare multe salate e gravi danni alla reputazione. Le aziende B2B non possono permettersi di ignorare questi sviluppi. Al contrario, devono considerarli come un'opportunità per distinguersi, costruendo fiducia e dimostrando un impegno etico. La conformità non è un ostacolo, ma un pilastro per l'innovazione sostenibile e l'accettazione sociale delle nuove tecnologie.

Costruire una Governance AI Responsabile: L'Approccio B2B

Come possono le aziende B2B, specialmente PMI e startup, navigare questo complesso panorama? La risposta risiede nello stabilire framework di governance solidi e strategie di conformità proattive. Ecco alcuni passi essenziali:

- Valutazione del Rischio: Identificare i sistemi AI che rientrano nella categoria 'alto rischio' secondo l'AI Act e altre normative pertinenti. Questo include la mappatura dei dati utilizzati, delle decisioni prese e dei potenziali impatti negativi.

- Trasparenza e Spiegabilità: Integrare il principio di 'AI by design' che favorisca la trasparenza. Ciò significa progettare sistemi che possano spiegare le loro decisioni in modo comprensibile, evitando 'scatole nere' imperscrutabili. Strumenti e metodologie di XAI (Explainable AI) sono sempre più maturi.

- Data Quality e Mitigazione del Bias: Assicurarsi che i dataset di training siano rappresentativi, puliti e privi di bias. Questo richiede un'attenta curatela dei dati e, quando necessario, l'applicazione di tecniche di debiasing. Un dato pulito è la base di un'AI etica.

- Supervisione Umana: Garantire che ci sia sempre un anello di controllo umano. Anche gli algoritmi più sofisticati richiedono una revisione. In Logika.studio, crediamo fermamente nella '100% revisione umana' per ogni soluzione che implementiamo, garantendo non solo l'accuratezza tecnica ma anche la conformità etica e normativa.

- Ownership e Controllo: Le aziende devono mantenere la piena proprietà del codice e dei modelli AI sviluppati per loro. Questo garantisce controllo, flessibilità e la possibilità di effettuare audit interni e adeguamenti rapidi, un punto che noi riteniamo fondamentale e su cui basiamo il nostro modello di collaborazione.

- Audit Regolari e Documentazione: Implementare processi per audit interni ed esterni sui sistemi AI, documentando decisioni di progettazione, dati utilizzati e risultati. Questa tracciabilità è vitale per la conformità e la gestione della responsabilità.

L'AI è un motore di crescita ineguagliabile. Tuttavia, il suo impatto positivo è condizionato dalla nostra capacità di gestirla in modo etico e conforme. Investire oggi in una governance AI solida non è un costo, ma un pilastro per la crescita e la fiducia nel domani digitale. Siete pronti a costruire il vostro futuro AI con la responsabilità che merita?