Intelligenza Artificiale per il tuo business

Pipeline RAG, agenti multi-LLM, server MCP custom. AI come amplificatore del tuo team, con ownership totale dei dati.

Progettiamo sistemi AI production-ready: pipeline RAG (Retrieval-Augmented Generation) con vector DB ed embedding, sistemi multi-agente orchestrati con LangChain, LangGraph e Pydantic AI, fine-tuning di LLM open-source per task di dominio, server MCP (Model Context Protocol) custom e workflow automation. Dalle chatbot agli agenti autonomi, dalla categorizzazione intelligente di email, ticket e documenti alla ricerca semantica su knowledge base aziendali.

- ✓Processi ripetitivi automatizzati senza sostituire le decisioni umane critiche: AI come amplificatore, non come black box

- ✓RAG su knowledge base private con controllo granulare di cosa l'AI può leggere e citare nelle risposte

- ✓Multi-LLM senza lock-in (OpenAI, Anthropic, Gemini, Mistral, Groq, Ollama locale) — cambi provider quando cambia il pricing

- ✓Fine-tuning su dati proprietari per ottenere risposte coerenti con il tuo tone of voice e dominio di business

Tipologia, tempi, prezzi e stack

| Tipo progetto | RAG, agenti, chatbot, document processing, workflow automation, server MCP custom |

|---|---|

| Tempi tipici | Da 3 a 10 settimane per MVP agente, iterazione continua su dataset e prompt |

| Range prezzo | POC da €10k · Implementazione da €25k |

| Stack tipico | LangChain, LangGraph, Pydantic AI, pgvector, Qdrant, OpenAI, Anthropic, Ollama, n8n |

Case study correlati

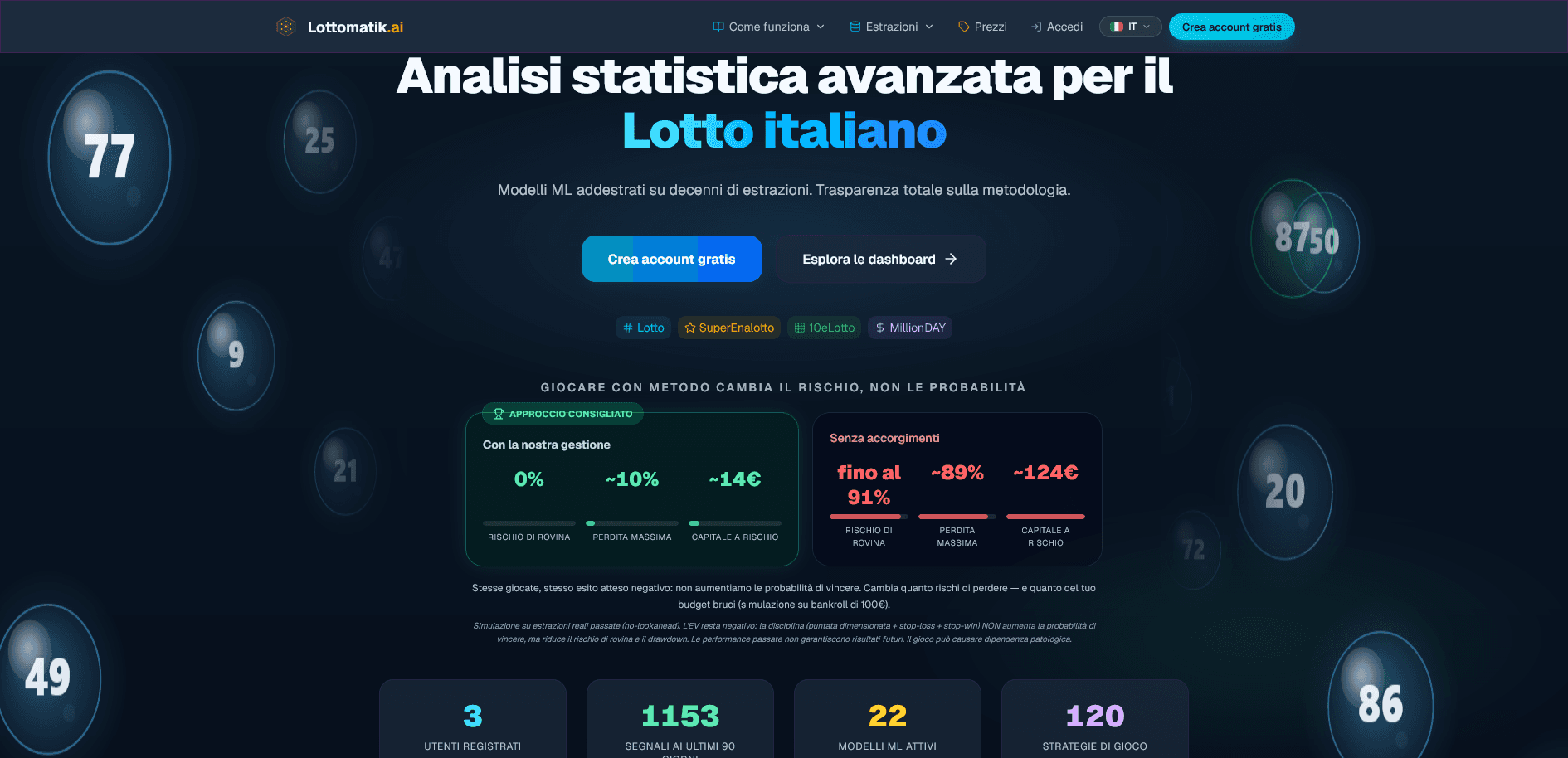

Lottomatik.ai

Ecosistema mobile + web per l'analisi statistica delle lotterie italiane: app native iOS e Android con AI vocale, dashboard web ML/AI e backend predittivo. Sviluppo full-stack completo.

TurboIntrastat

Piattaforma SaaS AI-powered per automatizzare le dichiarazioni Intrastat. Sito marketing + webapp in produzione su turbointrastat.com

Domande frequenti

I miei dati finiscono nel training di OpenAI o Anthropic?+

No, se usiamo le loro API enterprise (no-training by default) oppure se deployiamo modelli open-source localmente con Ollama o vLLM. Documentiamo per iscritto il data flow prima di iniziare.

Quanto costa un sistema AI custom?+

Per un POC su scope definito (chatbot RAG su documenti interni, agente single-tool) partiamo da €10k. Per implementazioni production con multi-agent, integrazioni e MLOps siamo da €25k in su, scalando con numero di tool e fonti dati. Forniamo preventivo concreto dopo discovery.

Cos'è RAG e quando ha senso rispetto a un semplice chatbot?+

RAG (Retrieval-Augmented Generation) permette all'LLM di rispondere basandosi su documenti tuoi aggiornati in tempo reale invece che solo sul training generico. Ha senso quando l'accuratezza su knowledge interna è critica (supporto, legale, medicale, tecnico).

Posso cambiare provider LLM dopo il lancio?+

Sì, architettiamo sempre con layer di astrazione che permette di swappare OpenAI, Anthropic, Gemini o modelli locali Ollama senza riscrivere la business logic. Zero lock-in sul provider.

Come valutate la qualità delle risposte generate?+

Definiamo insieme metriche di valutazione (relevance, factual accuracy, tone), costruiamo un golden dataset di test e misuriamo ogni release contro il baseline. Nessun 'funziona bene' senza numeri.

Potete integrare l'AI nei nostri sistemi esistenti (CRM, ticketing, email)?+

Sì, tramite API, webhook, n8n o server MCP custom. Esperienza consolidata su integrazione con Supabase, HubSpot, Zendesk, email transazionale e knowledge base interne.

Cosa significa deployare un server MCP custom?+

MCP (Model Context Protocol) è lo standard aperto che permette a Claude, Cursor e altri tool AI di accedere in modo sicuro a tool e dati interni. Costruiamo server MCP che espongono le tue API interne come tool invocabili dagli assistenti AI.

Come lavoriamo

Il nostro processo agenzia in 5 step

- 1

Discovery & Spec

Analizziamo obiettivi, vincoli e KPI insieme al team prodotto del cliente. Definiamo scope, deliverable e criteri di accettazione prima di stimare — niente stime su scope sfocato.

- 2

Architettura

Disegniamo data model, integrazioni esterne e contratti tra moduli. Niente codice prima che la mappa sia chiara: risparmi settimane di refactor a valle.

- 3

Sviluppo iterativo

Cicli brevi con demo settimanale al cliente, branch dedicato per ogni feature, code review continuo. Ogni release è production-ready, non un prototipo buttato là.

- 4

Review & test

Test automatici, checklist QA, audit di sicurezza e accessibilità prima del rilascio. Niente sorprese in produzione, niente incident nelle prime 48 ore.

- 5

Deploy & handover

Deploy in produzione, documentazione operativa e training del team interno per autonomia totale post-progetto. Puoi continuare con noi o passare la palla senza dipendenze nascoste.