L'evoluzione degli agenti di Intelligenza Artificiale sta riscrivendo le regole dell'ingegneria del software, trasformando quello che un tempo era fantascienza in una realtà operativa. Non si tratta più solo di algoritmi che predicono o classificano, ma di entità capaci di comprendere, agire e persino risolvere problemi complessi nel ciclo di sviluppo. Questi agenti stanno superando benchmark critici, offrendo capacità che spingono gli sviluppatori a riconsiderare i modelli di produzione tradizionali.

L'Ascesa degli Agenti AI e la Ridefinizione del Workflow

Assistenti intelligenti come GitHub Copilot hanno già dimostrato il potenziale di integrazione dell'AI nel workflow quotidiano. La loro capacità di suggerire blocchi di codice, completare funzioni e persino generare test sta non solo accelerando i tempi di sviluppo, ma sta anche influenzando i modelli di business e di utilizzo del software. Un tempo, la scrittura di codice era un processo puramente artigianale; oggi, è un'orchestra in cui l'AI agisce come un co-pilota esperto, amplificando la produttività del singolo sviluppatore.

Ma l'evoluzione non si ferma ai suggerimenti. Gli agenti AI di nuova generazione, spesso costruiti su framework come LangChain o sistemi ispirati a Auto-GPT, sono progettati per operare in maniera più autonoma. Possono analizzare un requisito, suddividere il problema in sotto-compiti, generare codice, testarlo e, in alcuni casi, persino distribuirlo. Questo cambio di paradigma è profondo: da semplici strumenti di assistenza, gli agenti si stanno trasformando in attori capaci di intraprendere iniziative, aprendo nuove frontiere per le PMI italiane che cercano efficienza e innovazione nel software su misura.

La Sfida della Valutazione: Oltre i Benchmark Tradizionali

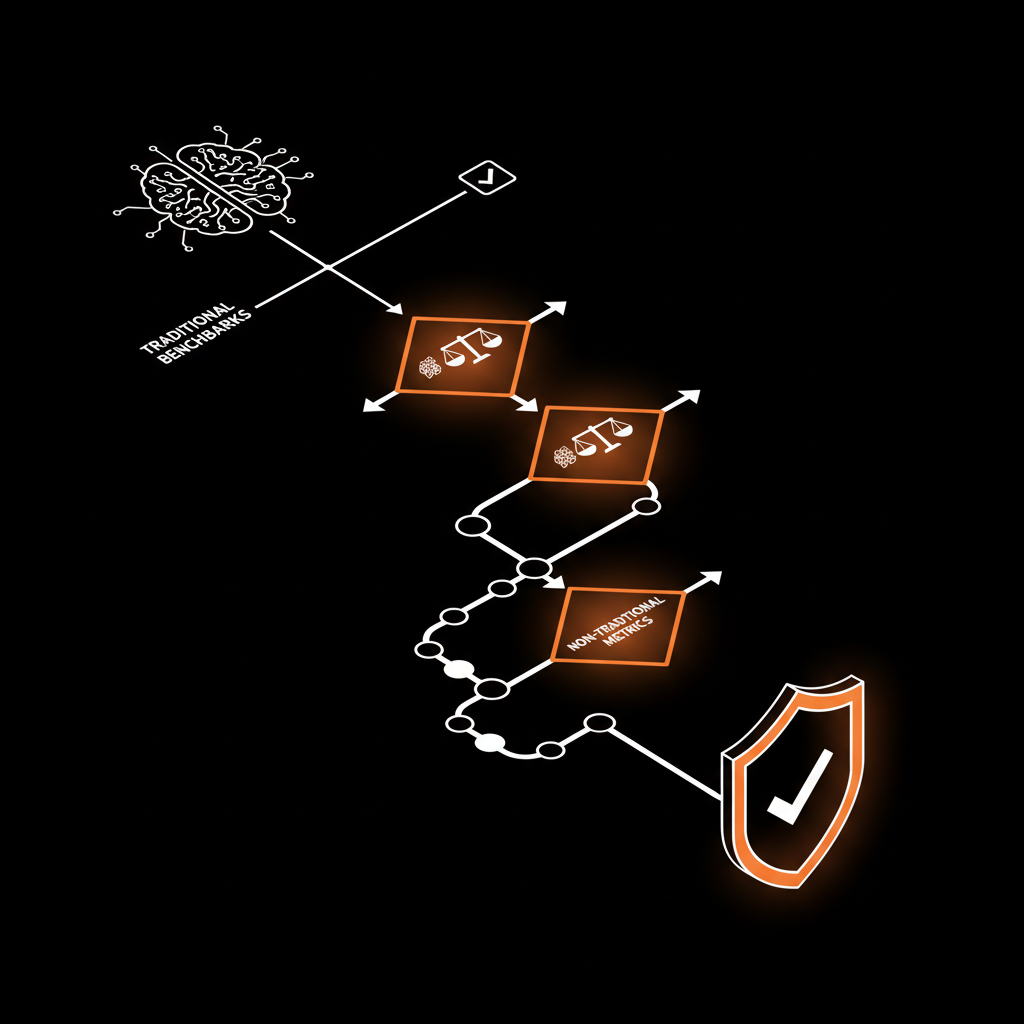

Con l'aumento delle capacità degli agenti AI, la necessità di metodi di valutazione robusti è diventata critica. Non basta più misurare la precisione di un modello linguistico o la sua capacità di generare testo coerente. Dobbiamo capire quanto siano efficaci nel risolvere problemi di ingegneria del software nel mondo reale. È qui che entrano in gioco benchmark come SWE-bench.

SWE-bench è un dataset complesso progettato per valutare la capacità degli agenti AI di risolvere issue reali dai repository GitHub, che vanno dal bug fixing all'aggiunta di nuove funzionalità. Non si tratta di test a scelta multipla, ma della capacità di generare patch funzionanti che passino tutti i test esistenti e, a volte, di crearne di nuovi. I risultati attuali, sebbene in costante miglioramento, mostrano che anche gli agenti più avanzati raggiungono percentuali di successo ancora lontane da quelle umane. Questo sottolinea un punto fondamentale: mentre gli agenti possono essere incredibilmente rapidi nel proporre soluzioni, la revisione umana al 100% rimane un presidio irrinunciabile per garantire qualità, sicurezza e aderenza alle specifiche del cliente. In Logika.studio, crediamo fermamente che la velocità (siamo 3-5× più rapidi di un'agenzia tradizionale) debba sempre andare a braccetto con la massima affidabilità.

Agenti Autonomi in Produzione: Potenziali Rischi e Controllo Umano

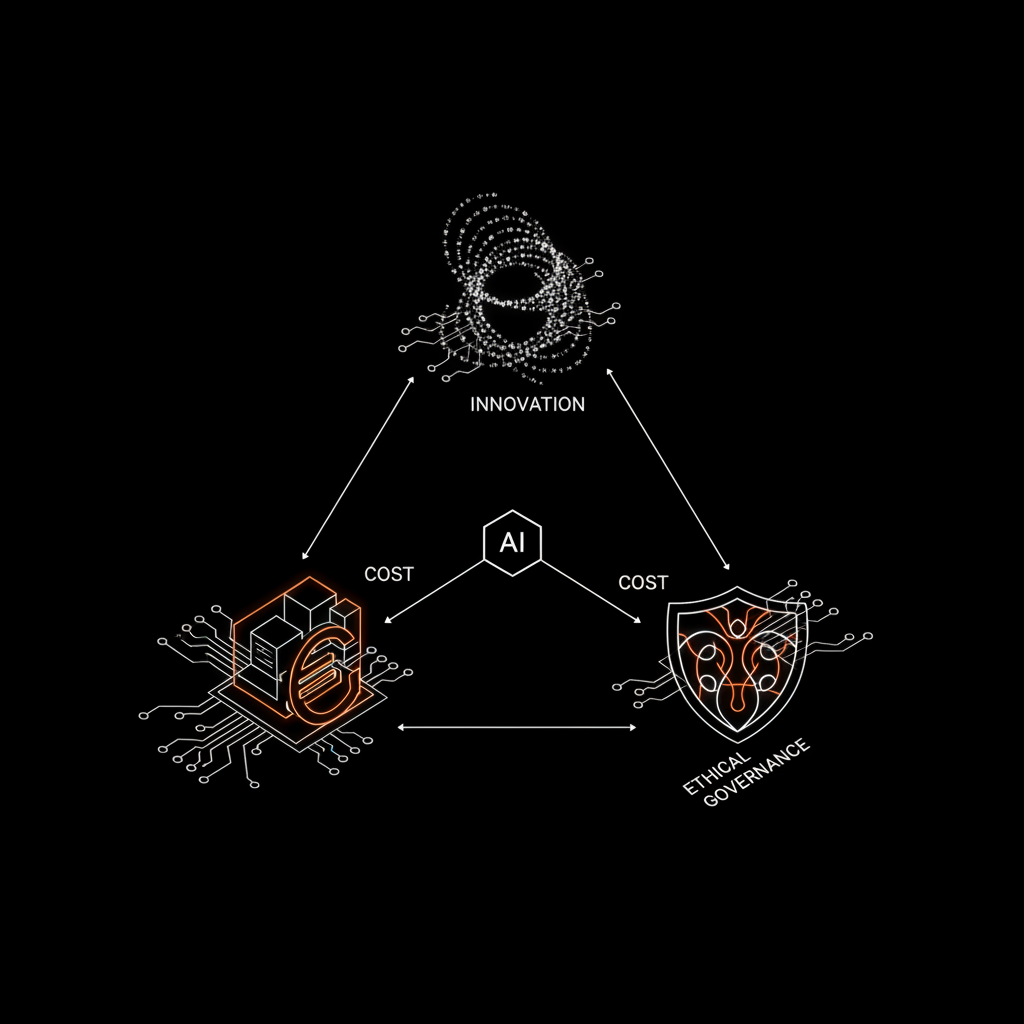

L'idea che gli agenti AI possano interagire autonomamente con sistemi di produzione apre scenari entusiasmanti ma anche potenzialmente rischiosi. Immaginate un agente AI che monitora un'applicazione di trading algoritmico, identifica un'anomalia, diagnostica la causa e deploya una patch correttiva. La velocità di reazione sarebbe impareggiabile. Tuttavia, un agente che operi senza una supervisione adeguata può introdurre vulnerabilità di sicurezza, causare interruzioni di servizio o generare effetti indesiderati a catena. Le problematiche di sicurezza e operatività diventano primarie.

Ecco perché l'approccio di Logika.studio è quello di sfruttare la potenza di 'sciami di agenti' AI sotto la supervisione e la guida di un singolo referente umano esperto. Questo modello garantisce non solo l'efficienza e la velocità degli agenti, ma anche la piena ownership del codice per il cliente e una rigorosa revisione umana in ogni fase. Strumenti come Polars per l'analisi dati o le API di Claude/Gemini/OpenAI per l'interazione linguistica sono mattoni fondamentali, ma il vero valore aggiunto risiede nell'orchestrare questi strumenti con intelligenza e responsabilità, specialmente quando si tratta di AI applicata alle PMI.

Il futuro dello sviluppo software è innegabilmente ibrido, un connubio tra l'intelligenza artificiale e la perspicacia umana. La sfida non è sostituire lo sviluppatore, ma potenziarlo, liberandolo dai compiti ripetitivi e permettendogli di concentrarsi sulla complessità e l'innovazione. Come possiamo quindi bilanciare al meglio l'autonomia degli agenti AI con la necessità di controllo umano e la garanzia di sicurezza in un ambiente di produzione dinamico?